Ilustracija iStock

Stručnjaci upozoravaju kako bi AI chatbotovi mogli generirati pogrešne informacije za glasače

povezane vijesti

Ovih dana Julia Mueller za The Hill i Yahoo piše o tome kako brz porast umjetne inteligencije izaziva zabrinutost da bi tehnologija mogla utjecati na izbore 2024. godine. Prema njezinim riječima, ova napredna tehnologija koja može generirati tekst, slike i zvuk, pa čak i stvoriti lažne videozapise, mogla bi potaknuti dezinformacije u već polariziranom političkom krajoliku i dodatno narušiti povjerenje birača u izborni sustav u Sjedinjenim Američkim Državama.

»2024. bit će izbori za umjetnu inteligenciju, slično kao što su 2016. ili 2020. bili izbori za društvene mreže«, rekao je Ethan Bueno de Mesquita, privremeni dekan na Harris School of Public Policy Sveučilišta u Chicagu. »Svi ćemo kao društvo učiti o načinima na koje ovo mijenja našu politiku.«

Stručnjaci upozoravaju kako bi AI chatbotovi mogli generirati pogrešne informacije za glasače ukoliko ih koriste za dobivanje informacija o glasačkim listićima, kalendarima ili biračkim mjestima – i također da bi se umjetna inteligencija mogla koristiti na podliji način, za stvaranje i širenje dezinformacija, kao i lažnih vijesti protiv određenih kandidata ili pitanja. »Mislim da bi se moglo prilično ‘smračiti’«, rekla je Lisa Bryant, predsjednica Odsjeka za političke znanosti na Kalifornijskom državnom sveučilištu u Fresnu i stručnjakinja za MIT-jev laboratorij za izbore.

Ankete pokazuju da zabrinutost oko umjetne inteligencije ne dolazi samo iz redova akademika: čini se da su Amerikanci sve više zabrinuti zbog toga kako bi tehnologija mogla zbuniti ili zakomplicirati stvari tijekom ionako spornog ciklusa 2024. godine. Anketa UChicago Harris/AP-NORC objavljena u studenome pokazala je da je dvostranačka većina odraslih Amerikanaca zabrinuta zbog upotrebe umjetne inteligencije koja »povećava širenje lažnih informacija« na predstojećim izborima. Anketa Morning Consulta ukazala je na porast posljednjih mjeseci u udjelu odraslih Amerikanaca koji su izjavili da misle da će umjetna inteligencija negativno utjecati na povjerenje u reklame kandidata, kao i na povjerenje u ukupni ishod izbora. Gotovo 6 od 10 ispitanika reklo je da misli da će dezinformacije koje širi umjetna inteligencija utjecati na to tko će u konačnici pobijediti u predsjedničkoj utrci 2024. godine.

National Conference of State Legislatures analizira uporabu umjetne inteligencije u izborima i kampanjama. Pritom podsjećaju da su se kandidati, predizborno osoblje i izborni administratori uvijek prilagođavali novim tehnologijama, bilo da se radilo o političkim oglasima koji su se pojavljivali sredinom 20. stoljeća bilo u novije vrijeme kada su anonimni prilozi u kriptovaluti postali opcija. S nedavnom pojavom višestrukih programa umjetne inteligencije koji mogu proizvesti realistične slike, videozapise i glasove u nekoliko sekundi, i kampanje i državni kreatori politike se prilagođavaju.

»Ljudi su oduvijek pokušavali promijeniti ili pogrešno predstaviti medije kako bi utjecali na izbore. Neke države imaju kaznene zakone o lažnom predstavljanju koji su doneseni prije pojave interneta, a koji se mogu primjenjivati na umjetnu inteligenciju, kao što je Wisconsin 12.05 donesen 1976. godine. U 2023. zakonodavstvo može koristiti različite izraze kao što su »deepfake«, »sintetički mediji« ili »obmanjujući mediji« kada se govori o umjetnoj inteligenciji. Svi se ovi izrazi odnose na ono što ljudi obično smatraju umjetnom inteligencijom, ali mogu imati različite implikacije ovisno o tome koji se izraz koristi i kako ga zakon definira. Ove su godine donesena dva zakona, oba povezana s korištenjem sadržaja generiranog umjetnom inteligencijom«, navodi National Conference of State Legislatures, donoseći na svojoj web-stranici sve postojeće statute i zakone koji reguliraju korištenje umjetne inteligencije na izborima.

Kako prenosi Nacional, Sam Altman, izvršni direktor kreatora ChatGPT-ja, OpenAI, rekao je na kongresnom saslušanju u Washingtonu da modeli koji stoje iza najnovije generacije AI tehnologije mogu manipulirati korisnicima. »Opća sposobnost ovih modela da manipuliraju i uvjere, da daju interaktivne dezinformacije jedan na jedan značajno je područje koje izaziva zabrinutost. Regulacija bi bila prilično mudra: ljudi moraju znati razgovaraju li s umjetnom inteligencijom ili je li sadržaj koji gledaju generiran ili ne. Sposobnost stvarnog modeliranja… predviđanja razmišljanja ljudi, mislim da će zahtijevati kombinaciju tvrtki koje rade pravu stvar, regulacije i obrazovanja javnosti«, smatra Altman.

Premijer Rishi Sunak izjavio je da će Britanija prednjačiti u ograničavanju opasnosti umjetne inteligencije. Zabrinutost oko tehnologije porasla je nakon otkrića o generativnoj umjetnoj inteligenciji, gdje alati kao što su ChatGPT i Midjourney proizvode uvjerljiv tekst, slike, pa čak i zatraženi glas. »S obzirom na razinu razvoja postoji opravdani strah da ChatGPT i druge tehnologije povećavaju izglede za interaktivno miješanje u izbore u velikim razmjerima. Umjetna inteligencija uvježbana da ponavlja teme o Tajvanu, klimatskim slomovima ili LGBT+ pravima mogla bi vezati političke protivnike u besplodne rasprave dok bi uvjeravala promatrače preko tisuća različitih računa društvenih medija odjednom«, piše Nacional.

Profesor Michael Wooldridge, direktor zaklade za istraživanje umjetne inteligencije na britanskom Institutu »Alan Turing«, rekao je da su dezinformacije koje pokreće AI njegova glavna briga u vezi s ovom tehnologijom.

»Upravo sada u smislu mojih briga zbog njezinih mogućnosti, umjetna inteligencija je broj jedan na popisu. Pred nama su izbori u Velikoj Britaniji i SAD-u i znamo da su društveni mediji nevjerojatno moćan kanal za dezinformacije. Ali sada znamo da generativna umjetna inteligencija može proizvoditi dezinformacije na industrijskoj razini«, kazao je.

Wooldridge je dodao da chatbotovi kao što je ChatGPT mogu proizvesti prilagođene dezinformacije usmjerene prema, na primjer, konzervativnim glasačima u matičnim okruzima, laburističkim glasačima u gradskom području ili republikanskim pristašama na srednjem zapadu. »To je poslijepodnevni posao za nekoga s malo iskustva u programiranju da stvori lažne identitete i jednostavno počne generirati ove lažne vijesti«, zaključio je.

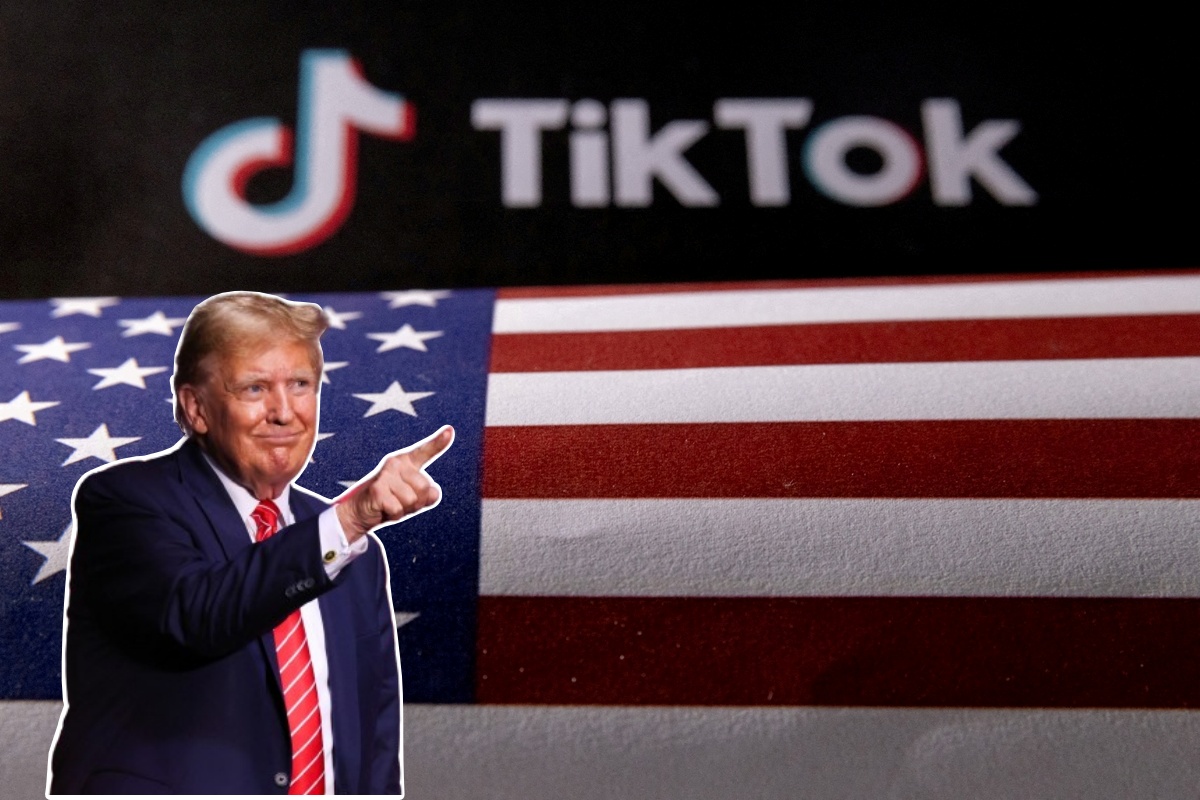

Nakon što su lažne slike uhićenja Donalda Trumpa u New Yorku postale viralne, izražena je zabrinutost zbog generiranih slika koje se koriste za zbunjivanje i dezinformiranje. Kako mogućnosti umjetne inteligencije postaju sve naprednije, postoji opravdana zabrinutost da postaje sve teže vjerovati bilo čemu s čime se susrećemo na internetu, bilo da je riječ o dezinformacijama kada se neistina širi greškom bilo dezinformacijama gdje se lažni narativ generira i namjerno distribuira.

Kloniranje glasa, primjerice, postalo je poznato nakon što se pojavio lažirani video američkog predsjednika Joea Bidena, u kojem je snimka njegovog govora o slanju tenkova u Ukrajinu transformirana pomoću tehnologije glasovne simulacije u napad na transrodne osobe – i podijeljeno je na društvenim mrežama. Za izradu lažne verzije korišten je alat koji je razvila američka tvrtka ElevenLabs. Viralna priroda isječka pomogla je potaknuti druge prijevare, uključujući jednu u kojoj Bill Gates navodno kaže da cjepivo protiv COVID-19 uzrokuje sidu. ElevenLabs, koji je priznao da se susreće sa sve većim brojem slučajeva zlouporabe kloniranja glasa, od tada je pooštrio zaštitne mjere protiv uznemirujućeg korištenja svoje tehnologije. Prema pisanju Guardiana, Recorded Future, američka tvrtka za kibernetičku sigurnost, rekla je da bi se moglo pronaći lažne glumce koji prodaju usluge kloniranja glasa na internetu, uključujući mogućnost kloniranja glasova korporativnih rukovoditelja i javnih osoba. Alexander Leslie, analitičar Recorded Futurea, izjavio je da će se tehnologija samo poboljšati i postati dostupnija uoči predsjedničkih izbora u SAD-u, dajući tehnološkoj industriji i vladama mogućnost da odmah djeluju.

N1 i BIRD Incubator pokušali su odgovoriti na pitanje može li umjetna inteligencija predvidjeti pobjednika parlamentarnih izbora. Kako su naveli, razvoj tehnologija sa sobom nosi brojne etičke i sigurnosne probleme. Primjer je »deepfake« tehnologija koja može biti iskorištena u razne manipulacijske svrhe s ciljem stvaranja laži i manipuliranja javnosti ili za stvaranje lažnog sadržaja kako bi se kompromitiralo određenu osobu.

»’Deepfake’ tehnologija mora proći još taj jedan prijelaz gdje ti vidiš i osjetiš da to nije to, do onoga gdje će jako teško biti razlučiti što je stvarno. Kad razmišljaš o ‘deepfakeu’ kao nečemu što je alat za manipulaciju, bit će sve teže i teže povući neku granicu da ja mogu sam sebi doći reći ja vjerujem svojim očima jer kad sam nešto vidio to je tako. Sve afere koje su se vezale uz izvore, i u Americi, na kraju su iskorištavale istu boljku, da mi ljudi živimo u informacijskom ‘bubbleu’. Učimo, informiramo se od istih izvora i kad netko počinje kontrolirati signale koje dobivamo i počne nas hraniti nekim sadržajem, može oblikovati percepciju naše stvarnosti«, kaže Mislav Malenica, predsjednik udruge CroAI.